智能语音技术在我们的生活中随处可见,常见的智能应用助手、语音播报、近几年大热的虚拟数字人等等。智能语音是由语音识别、语音合成、自然语言处理等多项技术组成的综合技术。对开发者要求高,一直是企业应用的难点。

PaddleSpeech,一个飞桨语音模型库,为开发者提供语音识别、语音合成、声纹识别、语音分类等多种语音处理能力。所有代码开源,各种服务一键部署,附保姆级教学文档,让开发者轻松处理行业应用!

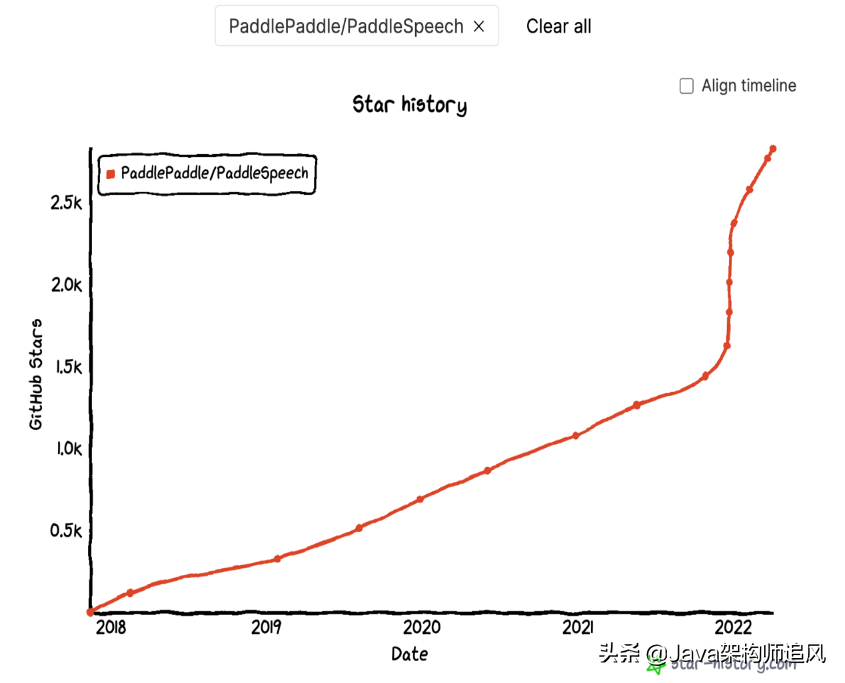

PaddleSpeech自开源以来受到开发者的广泛关注,关注度持续上升。

此次,PaddleSpeech版本正式发布,为开发者带来了四大重要升级:

全新PP-TTS发布:业界首个开源端到端流式语音合成系统,支持流式声学模型和流式声码器,开源一键流式语音合成服务部署方案。全新PP-ASR发布:基于数万小时数据的开源流式语音识别系统,开源一键流式语音识别服务部署方案。支持语言模型解码和个性化语音识别。全新PP-VPR发布:开源全链路声纹提取检索系统,10分钟轻松搭建工业级系统。一键服务能力:语音识别、语音合成、声纹识别、语音分类、标点恢复,五大核心语音服务一键部署。以下是本次发布的详细解读。

01

PP-TTS

业界首款开源端到端流式语音合成系统

语音合成是机器“说话”的“嘴”。随着深度学习技术的发展,端到端神经网络语音合成的效果相比传统技术有了很大的提高。但是端到端的语音合成响应时间长,在实时性要求高的场景下很难满足业务需求。

例如,在实时交互的虚拟数字人的应用中,虚拟人需要快速响应用户的指令,否则会消耗用户的耐心,降低用户的体验。这时候就需要流式语音合成系统在保证合成质量的同时提高响应速度和交互体验。

降低平均响应延迟的流式推理结构

以声学模型FastSpeech2和声码器HiFi-GAN为例,PP-TTS对FastSpeech2的解码模块进行了创新,用卷积结构代替FFT-Block,创新性地提出了一种基于FastSpeech2和HiFi-GAN的流推理结构,可以使声学模型和声码器的输出与非流推理的输出以块为单位保持一致。

与端到端非流式合成相比,PP-TTS流式合成的平均响应延迟降低了97.4%,即使在普通CPU笔记本上也能实时响应。

文本前端优化

PP-TTS提供了一种面向中文场景的语音合成文本前端优化方案:针对时间、日期、电话、温度等常见非标准词的文本正则化。提出了变调、变调、G2P变调等针对汉语场景的开源解决方案。在自建的文本正则化测试集上,CER低至0.73%;以CSMSC数据集的拼音为地真,字音转换(G2P)的WER低至2.6%。

语音合成输出示例音频:00:000

基于数万小时数据的流式语音识别系统

如果说语音合成是机器的“嘴巴”,那么语音识别就是机器的“耳朵”。只有拥有准确的“耳朵”,机器才能变得更聪明。端到端非流式语音识别模型的优点是识别效果更好,缺点是系统延迟较大,无法满足实时交互场景的需求。为了解决这个问题,Paddlespeech版本带来了PP-ASR:一个基于WenetSpeech数万小时数据的流式语音识别系统。

个性化识别方案

基于WFST的个性化识别方案支持特定场景下的语音识别任务。比如在交通报销场景下,一般的语音识别对POI、日期、时间等实体的识别效果很差。基于WFST的个性化识别可以提高识别准确率。在打车报销内测集上,普遍认可度CER为5.4%,优化CER为1.32%,绝对提升4.08%。

03

PP-VPR

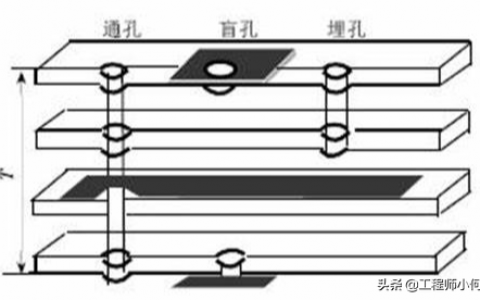

全链路声纹识别和音频检索系统

声纹特征作为一种生物特征,具有防伪性好、不易篡改和窃取等优点。结合语音识别和动态密码技术,非常适合远程身份认证场景。在声纹识别技术的基础上,结合音频检索技术(如语音、音乐、说话人检索等。),我们可以在海量的音频数据中快速查询并找出相似的声音(或同一说话人)片段。

其中声纹识别是典型的模式识别问题,其基本系统架构如下:

一键部署五种核心语音服务

语音识别、语音合成、声纹识别、声音分类和标点符号恢复。

在工业应用中,将训练好的模型以服务的形式提供给他人更方便。考虑到构建一个完整的网络服务应用是一项繁琐的工作,PaddleSpeech为大家提供了一键部署服务。命令行一行代码可以同时启动语音识别、语音合成、声纹识别、声音分类、标点符号恢复五项服务。

演示的使用和展示

进入demo/speech_server目录,一键启动语音识别、语音合成、声纹识别、声音分类、标点恢复等服务。

客户呼叫,以语音识别为例:

这么好的项目,欢迎大家来鼓励明星。

很抱歉,链接不能放在这里。有需要的同学可以自己去GitHub下载代码体验。找不到或者懒得找的同学可以直接拿我编译好的代码和开发笔记来玩。

老规矩,转发此文,关注私信[语音]

内容来源网络,如有侵权,联系删除,本文地址:https://www.230890.com/zhan/235712.html